Изображение, созданное нейросетью Midjourney по запросу «проверка на интеллект»

Изображение, созданное нейросетью Midjourney по запросу «проверка на интеллект»

В конце ноября 2022 года компания OpenAI выпустила свой новый чат-бот ChatGPT, который мгновенно стал интернет-сенсацией: всего через пять дней после выхода у него было уже больше миллиона пользователей. Казалось, он умеет все на свете: от написания школьных сочинений и компьютерного кода — до библейских текстов про бутерброд в магнитофоне.

ЗАПРОС:

Напиши текст в «библейском» стиле, объясняющий, как извлечь бутерброд с арахисовым маслом из видеомагнитофона.

ОТВЕТ:

«И было так, что человека беспокоил бутерброд с арахисовым маслом, потому что он был помещен в его видеомагнитофон, и не знал он, как его извлечь. И он воззвал к Господу, говоря: «О, Господь, как я могу вынуть этот бутерброд из моего видеомагнитофона, ибо он крепко застрял и не двинется с места?»

И Господь обратился к нему и молвил: «Не бойся, дитя мое, ибо Я направлю руку твою и укажу тебе путь. Возьми свой нож для масла, осторожно вставь его между бутербродом и видеомагнитофоном и аккуратно раздвинь их. И с терпением и настойчивостью бутерброд будет удален, а твой видеомагнитофон сохранен».

И человек сделал, как повелел Господь, и, о чудо, бутерброд был извлечен из видеомагнитофона, и человек был спасен.

И Господь сказал: «Истинно говорю тебе, не пытайся класть свои бутерброды с арахисовым маслом в видеомагнитофон, ибо это неподходящее место для таких вещей. Лучше храни свои бутерброды в холодильнике или на тарелке, где им самое место». И этот человек внял словам Господа, и с того дня он держал свои бутерброды в надлежащем месте, и был спасен от неприятностей и горя. Аминь».

Картинка по запросу «сэндвич в видеомагнитофоне», созданная нейросетью Midjourney

Хотя похожие системы, умевшие писать тексты в разных стилях, появлялись и раньше, в случае с ChatGPT чувствовался качественный скачок. Ответы были связными, шутки — забавными, информация — верной и кратко сформулированной, а компьютерный код, написанный ботом, компилировался, запускался и работал. После нескольких непродолжительных бесед ChatGPT представился мне первым искусственным интеллектом практически человеческого уровня, который мог выполнять любые задачи так или иначе связанные с текстом.

Особенно меня, как научного журналиста, интересовала способность ChatGPT писать о науке понятным языком. Он с легкостью выдает как сложные наукообразные тексты, так и объяснения «на пальцах» для младших школьников. Свести к нескольким буллет-пойнтам сложную научную статью или сформулировать главные мысли философского труда на тысячу страниц в одном абзаце, он, в отличие от меня, может за несколько секунд. Тогда-то я и решил отнестись к нему серьезно.

Но что значит «серьезно»? Если я поверю, что в ближайшем будущем мою работу легко выполнит компьютер, значит мне нужно искать новую работу. И вообще, новую работу надо искать всем журналистам, копирайтерам, пиарщикам, маркетологам, юрисконсультам — тем, кто имеет дело с текстами. А если учесть способность ChatGPT писать на языках программирования, работу придется искать и программистам, и дата-аналитикам. А если добавить к ИИ, генерирующему текст, ИИ, синтезирующий речь, — то на улицу хлынут потоки безработных сотрудников колл-центров, секретарей, радиоведущих, подкастеров, учителей… А если еще добавить технологию, генерирующую лицевые анимации в реальном времени…

Чувствуя себя близким к умопомешательству я решил, что заранее сдаваться на милость искусственного интеллекта не стоит: лучше сначала разобраться, что ChatCPT дается хорошо, а что не очень, и уже потом делать выводы о всеобщей безработице. Я начал экспериментировать.

К слову, выдающиеся способности ChatGPT пока проявляет только на английском языке, потому что учился он, в основном, на англоязычных текстах. Поэтому все разговоры с ним, приводимые далее, как и притча о бутерброде в начале статьи, будут переводами с английского. Переводчиком ChatGPT работать может, но получается у него хуже, чем у Гугла или Яндекса, поэтому тексты наших с ним бесед переведены с английского гугл- или яндекс-транслейтом и отредактированы мной.

Разговор со специалистом

Языковую модель GPT-3, на которой работает ChatGPT, компания OpenAI выпустила еще в 2020-м году. Первая модель произвела на пользователей большое впечатление, но релиз был ограниченным и вскоре стал платным. Следующую модель GPT-2 OpenAI не выпустили вообще, ссылаясь на то, что она может быть слишком легко использована во вред. Зато GPT-3 стала не только более безопасной, но еще и обучилась за два года разговоров с людьми поддерживать весьма «человеческие» диалоги в чате.

Благодаря этому ChatGPT лучше всего отвечает на вопросы и помогает людям в формате диалога. А так как объем текстов, на которых обучен ИИ, таков, что вся англоязычная Википедия составляет в нем всего полпроцента, то разговор выходит весьма информативным. Так, например, ChatGPT помог пользователю починить свою машину.

У юзера Reddit с ником kmsherrin плохо заводилась машина. Он спросил у ChatGPT, в чем может быть проблема, и получил в ответ длинный список возможных неполадок. В течение пары дней kmsherrin проверил каждую из них, но ни одна из догадок нейросети не оправдалась. Тогда kmsherrin описал свою проблему более подробно и спросил, может ли она быть вызвана какими-то другими, нестандартными причинами.

ЗАПРОС:

Ни одно из твоих решений не подходит. Есть ли что-то более необычное, что может быть причиной проблемы? Машина заводится, но далеко не с первой попытки.

ОТВЕТ:

Возможными причинами проблемы могут быть засорение топливопровода, неисправный блок управления двигателем (ECU), изношенный или поврежденный ремень или цепь газораспределительного механизма или проблема с реле топливного насоса. Также возможно, что проблема вызвана неисправным датчиком положения коленчатого вала или датчиком положения распределительного вала.

Как оказалось, проблема действительно была в датчике положения коленчатого вала, и kmsherrin-у удалось значительно сэкономить на ремонте машины.

Чтобы повысить эффективность разговоров, до того, как задать первый вопрос, можно запрограммировать ИИ на определенное поведение. Например: «Далее ты будешь отвечать на вопросы от лица высококвалифицированного профессионала в [области, в которой задается вопрос]. Прежде, чем дать ответ, задай дополнительные вопросы, которые помогут сделать твой ответ более полезным и точным». Таким образом ChatGPT может моделировать психотерапевта, финансового аналитика, учителя физики или любого другого специалиста с которым вам было бы полезно поговорить. Понятно, что не стоит таким способом ставить себе диагноз или назначать лекарства, но обсудить какие-то идеи или получить полезный совет можно легко.

Вежливый секретарь

Поскольку ИИ неплохо имитирует высококвалифицированных специалистов, то уж кого он заменит наверняка, так это специалистов низкой квалификации. Chat GPT с легкостью может писать тексты рекламных объявлений и новостных рассылок, переписывать чужие статьи, подбирать ключевые слова для SEO (Search Engine Optimization, оптимизации текстов для повышения видимости в поисковиках), вести бизнес-переписку как вне, так и внутри компании. Чтобы помочь вам ощутить вкус недалекого будущего, я попросил ChatGPT написать корпоративное письмо, в котором сотруднику в форме извинения сообщается, что его увольняют и заменяют ИИ. Вот что он написал:

Уважаемый [имя работника],

От имени руководства компании мы хотели бы принести наши извинения за эффект, который наша инициатива по оптимизации окажет на вашу занятость. Интеграция технологии искусственного интеллекта привела к ликвидации ряда должностей, в том числе, и вашей.

Мы понимаем, что это изменение может вызвать некоторые неудобства, и ценим вашу самоотверженность и усердную работу во время вашего пребывания в компании. В знак благодарности компания хотела бы предложить вам специальное предложение на [название продукта].

Если у вас есть какие-либо вопросы или опасения, пожалуйста, не стесняйтесь обращаться к нам. Мы ценим ваше понимание и сотрудничество в процессе работы над оптимизацией нашей деятельности и сохранением конкурентоспособности.

Искренне,

[название компании]

Картинка по запросу «робот-секретарь», созданная нейросетью Midjourney

Но раз ИИ может заменять людей, значит, может и помогать им в поиске новой работы. В посте, набравшем больше 2000 лайков, пользователь Реддита, посвященного использованию ChatGPT рассказывает, как ИИ помог ему в поиске работы.

«У меня не было работы с июля (пост от 2 февраля — Ред.). Активно писал письма работодателям с октября. У меня очень хорошее резюме, и на прошлой работе у меня была высокая и довольно престижная должность. С октября я написал 49 писем, и мне предложили ОДНО собеседование.

В прошлую пятницу я начал использовать ChatGPT для написания сопроводительных писем в надежде быстрее подаваться на большее число вакансий. С прошлой пятницы я подал заявки на 12 вакансий, используя сопроводительные письма, написанные ChatGPT. С тех пор, за 4 рабочих дня, мне было предложено 3 собеседования в ответ на 12 писем. Всего за несколько дней!»

Другой пользователь там же описывает еще более разностороннюю помощь ИИ в поиске работы. Вот что сделал для него искусственный интеллект:

- написал сопроводительное письмо, адаптированное под вакансию

- дал тезисы для собеседования, привязав опыт работы в резюме к требованиям работодателя

- выступил в качестве интервьюера для проведения пробных интервью

- написал ответные имейлы

- выступил в роли психотерапевта, дав советы, как снизить тревожность по поводу поиска работы

Помощник программиста

А как насчет самой востребованной профессии современности — программирования? Как и многие в последний год, я решил на всякий случай выучиться хоть каким-то языкам программирования и записался на открытый гарвардский курс по Computer Science, CS50. В курсе, помимо лекций, есть и домашние задания, в которых нужно писать программы, которые, например, могут применять фильтры к картинкам или выписывать из текста слова, которых нет в словаре.

Иногда, когда я вообще не понимал, что нужно делать в той или иной задаче, я давал соответствующий кусок кода ChatGPT, и он каждый раз писал код, который компилировался и давал правильные ответы. А что еще важнее — сопровождал его комментариями и объяснениями, которые помогали мне разобраться, что именно и как надо делать. Из одной довольно сложной задачки на С (не самый простой язык) я ради эксперимента взял целиком кусок кода, куда надо было вписать несколько функций, и вставил его в ChatGPT с запросом в стиле «напиши функции куда надо, что они должны делать — догадайся по контексту», и он написал. И код заработал! Правда, код был с довольно хорошими комментариями, без них ИИ, скорее всего, не справился бы.

В разных отзывах о ChatGPT я читал, что он выдает работающий код в 85 — 90% случаев. Но даже когда он выдает нерабочий код или код с ошибками, общая структура программы оказывается полезной как отправная точка для дальнейшей работы. Также он может искать ошибки во введенном в него коде, правда, иногда обнаруживает ошибки, которых нет, или, наоборот, извиняется, что код не работает, но допускает ту же ошибку в «исправленной» версии.

Один мой друг, программист с 15-летним стажем, довольно скоро начал использовать ChatGPT в работе, но не для непосредственного создания кода. Вот что он мне написал:

«Мое впечатление от чатгпт в плане программирования как от очень начитанного джуна (младшего разработчика — Ред.) с потрясающей памятью, который нихрена при этом не понимает :)

Я бы так сказал, у него нет механизма самокритики и анализа собственных «мыслей» на совместимость между собой. Но в качестве справочного материала он прекрасен. Про шаблоны проектирования всё расскажет, покажет, с примерами. Даже выбрать поможет и плюсы и минусы корректно укажет. Но не дальше.»

Фантазии молодой нейросети

К ChatGPT можно обращаться и как к поисковой системе. Причем, в отличие от гугла, ChatGPT не дает 20 ссылок на непонятные страницы, каждую из которых приходится штудировать в поисках нужной информации. ИИ выдает ясно сформулированный и четкий ответ с примерами и пояснениями. При этом любую непонятную деталь можно уточнить и получить такой же развернутый и ясный ответ. В этой идиллии есть только один нюанс.

Любой ответ, который дает ChatGPT, как бы уверенно и авторитетно он ни звучал, может оказаться фикцией. А если попросить, то ИИ придумает для этой фикции и примеры, и объяснения, и даже сошлется на несуществующие литературные источники. Профессионалы называют это галлюцинациями. Но откуда они берутся?

Единственная задача, которую на самом деле выполняют языковые нейросети — это предсказание вероятности следующей буквы, следующего слога, следующего слова в контексте нескольких тысяч слов, на которые им хватает памяти. Объективная истина же никак не влияет на эту вероятность.

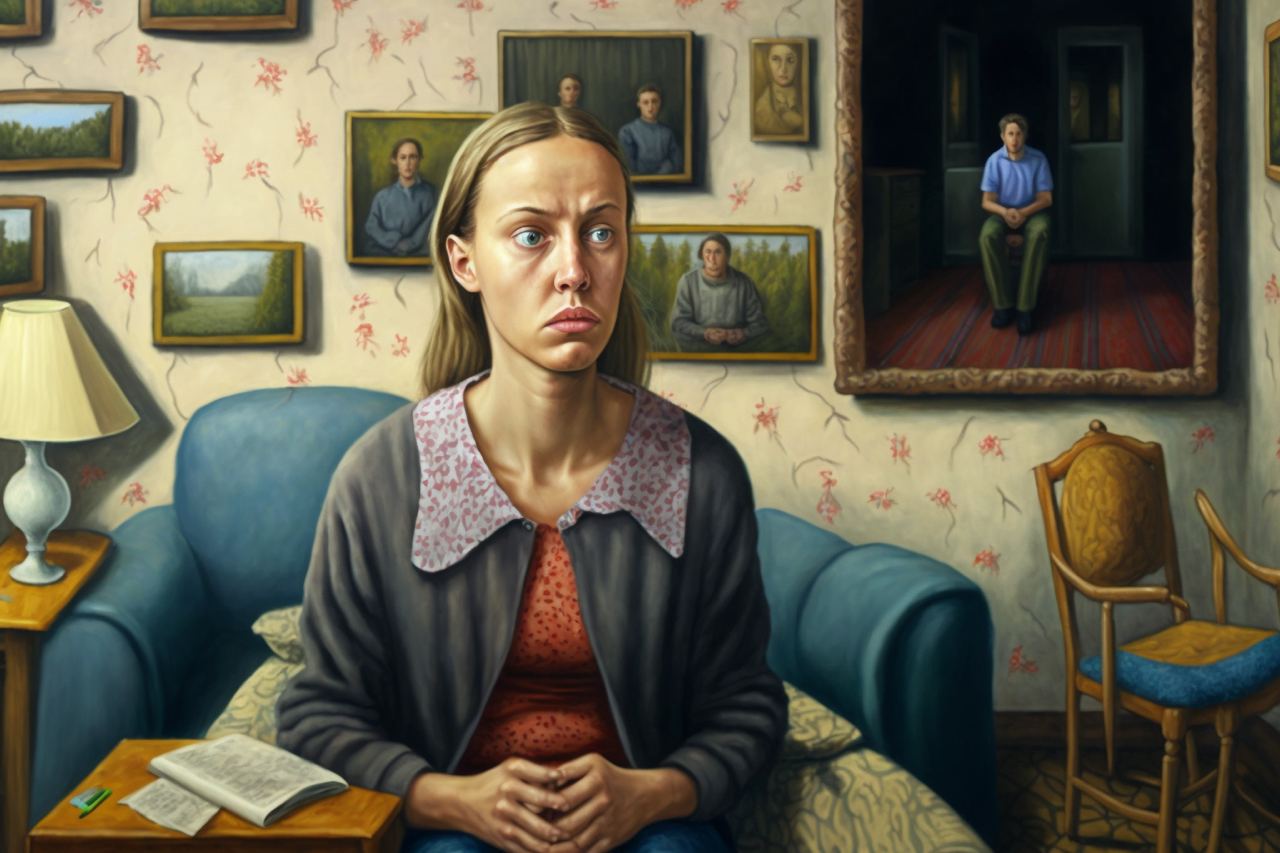

Картинка по запросу «нейросеть галлюцинирует», созданная нейросетью Midjourney

OpenAI борются с проблемой «галлюцинаций», но единственный способ, который они пока нашли, заключается в том, чтобы показывать ответы нейросети людям. Те будут проверять, верный ответ или нет, а ИИ на этих ответах будет учиться, что говорить можно, а чего нельзя. При таком методе выживают два типа результатов: верные ответы и убедительно звучащие ответы. Тем не менее, его можно считать успешным, потому что процент «галлюцинаций» оказывается, в конечном счете, невысоким. Да и в гугле запросто можно найти фейковую информацию, а по ясности и удобству изложения ChatGPT часто оказывается на голову выше обычных статей и туториалов.

В какой-то момент мне нужно было написать текст о вкладе академика Боголюбова в современную теоретическую физику. Одной из главных его работ в области математических основ квантовой теории поля было доказательство теоремы «об острие клина». Вот как эту теорему объясняет русская Википедия:

«Теорема Боголюбова «об острие клина» утверждает, что функция нескольких комплексных переменных, голоморфная в двух клиновидных областях с общим острием, на котором она непрерывна, является голоморфной и на острие. Данная теорема используется в квантовой теории поля для построения аналитического продолжения функций Вайтмана. … Важными применениями теоремы об «острие клина» являются: доказательство дисперсионных соотношений в квантовой теории поля, аксиоматическая квантовая теория поля, теория обобщённых функций, обобщение теоремы Лиувилля.»

Да, я тоже ничего не понял. А вот как на мой запрос ответил ChatGPT.

ЗАПРОС:

Напиши короткое, ясное и простое объяснение теоремы Боголюбова «об острие клина».

ОТВЕТ:

Теорема Боголюбова «об острие клина» — это правило, которое гласит, что при изучении частиц в определенной области с использованием приближений, результаты будут точными только в том случае, если частицы находятся близко к границе этой области. Эта граница называется «острием клина» и отделяет то, что можно знать о частицах внутри области, от того, что нельзя знать о частицах снаружи. Теорема помогает убедиться, что приближения, используемые в квантовой теории поля, дают надежные и непротиворечивые результаты.

Этот ответ, конечно, не математически строгий, но зато из него можно понять хотя бы что-то о физическом смысле и пользе теоремы. Да и просил я простое, а не строгое объяснение.

Проблемы с креативом

У ChatGPT плохо с математикой, потому что он — языковая модель. Как было сказано выше, он подбирает вероятности следующих букв по контексту предыдущих. С математикой такое не работает. Поэтому когда задаешь ему вопросы с вычислениями, он пишет цифры примерно похожие на правду, но часто неверные и с неправильными размерностями. Например, он может ответить, что объем одного килограмма воды равен 1 кубическому метру. Но это не страшно. Математика дается компьютерам намного лучше, чем людям, просто для вопросов по математике надо использовать не языковые модели ИИ, а интеллектуальные вычислительные системы, например, Wolfram|Alpha. Вполне возможно, что в будущем такие системы будут работать вместе и дополнять друг друга.

Другой критерий, по которому можно определить, хорошо ли что-то получится у языковой модели — это объем текста, на котором она обучалась. Например, ChatGPT — плохой переводчик из-за того, что объемы иноязычных текстов в его обучающей выборке были небольшими. Другой пример — музыка. ИИ не может учиться на картинках нот, а текстов, в которых ноты записаны буквами, в интернете явно недостаточно, чтобы научить нейросетку хорошо писать музыку.

Еще одна вещь, которая получается плохо — это длинные тексты. Когда я допытывался, может ли ИИ вместо меня писать научно-популярные статьи, он выдавал неплохие объяснения или выжимки статей. Также он легко мог предложить план для статьи или даже книги. Но заставить его написать текст длиннее, чем в несколько абзацев, трудно. Если после этого попросить его продолжать, то он, конечно, продолжит писать, но мысли и фразы начнут повторяться, а после нескольких длинных кусков он может вообще забыть, о чем изначально был текст, и уехать в другую тему.

Еще у него плохо с креативом и генерацией небанальных идей. В какой-то момент я пытался заставить его генерировать отрывки из несуществующих книг. Ему довольно неплохо удается писать синопсисы, например:

Жанр: Психологический триллер

Название: «Хранитель памяти»

Автор: Джиллиан Флинн

Краткое описание: «Хранитель памяти» — это роман о женщине, страдающей редким заболеванием, из-за которого она забывает свое прошлое каждый раз, когда ложится спать. По мере того, как она начинает собирать кусочки своего прошлого, она понимает, что ее воспоминания ей не принадлежали и что кто-то манипулирует ими. История увлекает читателя в захватывающее путешествие, где главная героиня борется за то, чтобы раскрыть правду о своем прошлом и о человеке, ответственном за ее состояние.

Неплохо, но когда я предложил ИИ описать персонажей или написать конкретную сцену, то персонажи всегда оказывались «картонными»: либо однозначно хорошими, либо однозначно плохими, сцены выходили топорно, а повороты сюжета всегда получались банальными. Скажем:

Доктор Лоуренс — мужчина средних лет с редеющими волосами, в очках в проволочной оправе и сдержанными манерами. У него худощавое телосложение, и его часто видят в лабораторном халате. Он блестящий ученый, специализирующийся на исследованиях памяти. Доктор Лоуренс умен, методичен и предан своей работе. Однако он также безжалостен и не остановится ни перед чем, чтобы достичь своих целей. Его цель — использовать состояние Авы для продолжения своих исследований и раскрытия секретов человеческого разума.

Картинка по запросу «женщина с потерей памяти на приеме у психоаналитика», созданная нейросетью Midjourney

А вот сцена из предполагаемого романа:

Доктор сидел напротив своей пациентки, которая нервно заламывала руки. Он глубоко вздохнул и начал сеанс.

«Ава, расскажи мне о своем последнем воспоминании».

Она посмотрела на него снизу вверх, ее глаза были полны страха. «Я… я не помню. Все как в тумане, каждый раз, когда я просыпаюсь, мне кажется, что я начинаю все сначала».

«Все в порядке, не торопись».

Ава глубоко вздохнула и закрыла глаза. «Я помню, как была в парке со своей дочерью. Мы играли на качелях, и она смеялась».

«Это хорошо. Ты можешь рассказать мне больше о своей дочери?"

Глаза Авы расширились. «У меня нет дочери. У меня… у меня никогда не было детей."

Доктор Лоуренс наклонился вперед с серьезным выражением лица. «Ава, мне нужно, чтобы ты выслушала меня. Кто-то манипулирует твоими воспоминаниями, тебе нужно помнить правду».

Ава покачала головой, слезы текли по ее лицу. «Я не могу. Это слишком, я не могу с этим справиться».

«Ты должна. Это единственный способ выяснить, кто делает это с тобой, и остановить их».

И это еще один из лучших примеров.

Выводы

Сильными сторонами ChatGPT можно назвать:

- доступ к огромным объемам информации

- способность находить в ней нужное и хорошо формулировать ответы

- возможность неограниченно уточнять информацию через дополнительные вопросы в диалоге

- понимание распространенных социальных норм и практик

- способность писать практически в любом стиле

- возможность использовать языки программирования и другие цифровые инструменты

Недостатками ChatGPT можно считать:

- недостаточную обученность на всех языках, кроме английского

- отсутствие самокритики и понимания смысла своих действий

- «галлюцинации», т.е. 5−10% вероятность выдачи фиктивной информации

- неспособность к точной работе с данными и цифрами

- плохие способности к генерации нестандартного контента

- плохое качество написания длинных связных текстов

Вполне возможно, что все, о чем я здесь написал, уже через несколько месяцев станет неактуальным, ведь ходят слухи, что уже в этом году OpenAI выпустят GPT-4, которая будет в сотни раз мощнее, чем GPT-3.

Но что это значит для меня? Искать ли мне новую работу?

Если и стоит, то я пока не понимаю, какую. Зато я неплохо разобрался в том, как ChatGPT может мне помочь с работой нынешней. Он удобен для поиска информации (хотя ее и надо перепроверять из-за «галлюцинаций»), его можно использовать как партнера для брейнштормов и как копирайтера для скучных имейлов. С его подсказками и примерами намного легче учиться программированию, а его «недопиленные» креативные идеи могут вдохновить на создание чего-то более качественного. А еще он не умеет писать длинные статьи, а я умею. Вот.